La ley de IA de Europa ya está aquí: ¿qué significa para ti?

⚠️ Nota editorial: Este artículo aborda regulación normativa y legal. Su contenido es informativo y no reemplaza el asesoramiento de un profesional jurídico o especialista en cumplimiento normativo. Para decisiones específicas sobre tu empresa o actividad, consulta a un experto.

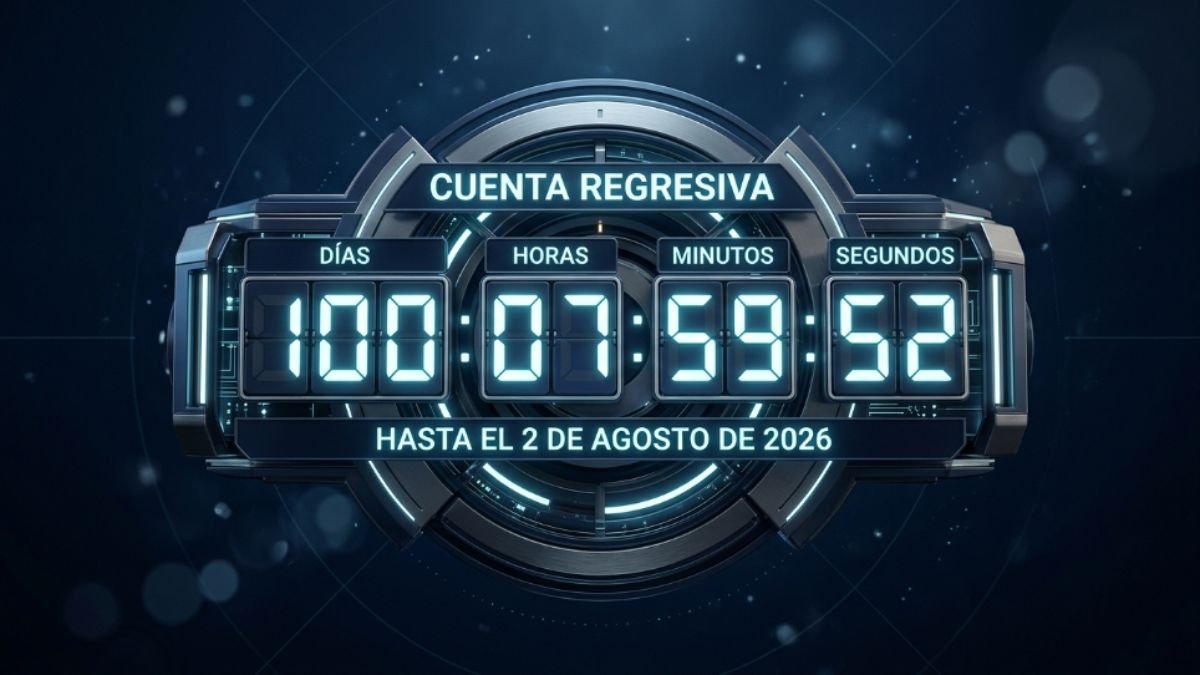

El 2 de agosto de 2026, una fecha que la mayoría de las personas ignora, es el momento en que la ley de IA de Europa entra en su fase más crítica. Ese día se activan las obligaciones principales del AI Act — la primera regulación integral sobre inteligencia artificial en el mundo — y las reglas del juego cambian de forma irreversible para cualquier empresa, desarrollador o profesional que use, construya o distribuya sistemas de IA.

No es un cambio menor. El AI Act tiene alcance extraterritorial: como el GDPR, se aplica a cualquier organización en cualquier parte del mundo que ofrezca productos o servicios a personas en la Unión Europea. Una startup en Ciudad de México, un freelance en Buenos Aires o un creador de contenido en Madrid que use herramientas de IA en su trabajo pueden verse afectados, dependiendo de qué sistemas usen y cómo.

Desde que la regulación de inteligencia artificial comenzó a tomar forma en Europa, el debate oscila entre dos extremos: quienes la ven como un freno innecesario a la innovación y quienes la consideran insuficiente frente a los riesgos reales de la tecnología. Ambas posturas dicen algo verdadero — y ninguna cuenta la historia completa.

En lo que sigue encontrarás una explicación honesta y sin jerga: qué prohíbe la ley, qué obliga, a quién afecta, cuándo, y qué está pasando en el resto del mundo mientras Europa lidera este debate.

Qué es el AI Act y por qué te afecta aunque no vivas en Europa

El AI Act (Reglamento de Inteligencia Artificial de la Unión Europea, Reglamento UE 2024/1689) es el primer marco regulatorio integral del mundo dedicado específicamente a la inteligencia artificial. Entró en vigor el 1 de agosto de 2024, pero sus obligaciones más relevantes se activan en fases entre 2025 y 2027.

La lógica central del AI Act no es regular la tecnología en sí — es regular el riesgo que esa tecnología genera para las personas. Cuanto mayor el potencial de daño, más estrictas las obligaciones. Un filtro de spam tiene muy poco riesgo. Un sistema que decide si alguien obtiene un crédito bancario o si un candidato pasa a la siguiente fase de un proceso de selección tiene un riesgo mucho mayor. Y las reglas para cada uno son completamente diferentes.

El alcance extraterritorial es el punto que más sorprende: si tu empresa está en cualquier parte del mundo pero ofrece servicios a clientes en la Unión Europea, el AI Act puede aplicarte. El criterio no es dónde está la empresa, sino dónde están las personas que usan sus sistemas de IA.

Principio clave del AI Act – La ley no regula la IA como tecnología. Regula los sistemas de IA según el riesgo que generan para los derechos fundamentales, la seguridad y la democracia de las personas. Esa distinción cambia completamente cómo se entiende el cumplimiento.

Las cuatro categorías de riesgo que determinan tus obligaciones

La arquitectura central del AI Act es una clasificación de riesgo en cuatro niveles. De qué categoría sea tu sistema — o el sistema que usa tu empresa — depende casi todo: las obligaciones, los plazos y las sanciones posibles.

Riesgo inaceptable: lo que ya está prohibido desde febrero de 2025

Esta categoría incluye los usos de IA que la Unión Europea considera incompatibles con los derechos fundamentales. Están prohibidos desde el 2 de febrero de 2025:

- Sistemas de puntuación social: clasificar a personas según su comportamiento social para determinar su acceso a servicios, como hacen algunos sistemas gubernamentales en otras regiones del mundo.

- Manipulación subliminal o explotación de vulnerabilidades: sistemas que usan técnicas de IA para influir en el comportamiento de personas sin su conciencia, o que explotan vulnerabilidades como la edad, la discapacidad o situaciones de angustia económica.

- Identificación biométrica masiva en tiempo real en espacios públicos: cámaras que reconocen caras a escala en espacios públicos. Se permiten excepciones muy restringidas para fuerzas de seguridad en situaciones específicas.

- Sistemas de inferencia de emociones en entornos laborales y educativos: herramientas que intentan deducir el estado emocional de empleados o estudiantes para tomar decisiones sobre ellos.

Riesgo alto: las obligaciones más exigentes — activas desde agosto de 2026

Esta es la categoría que más afecta a empresas y organizaciones. Los sistemas de IA de alto riesgo son aquellos que toman o influyen en decisiones con consecuencias significativas para personas: empleo, educación, crédito bancario, atención sanitaria, administración de justicia, control de fronteras.

Para estos sistemas, el AI Act exige documentación técnica completa, evaluaciones de riesgo, supervisión humana obligatoria, registro en una base de datos pública de la UE y procesos de conformidad antes de salir al mercado. Es el nivel más parecido a la regulación de productos médicos o aeronáuticos.

Riesgo limitado y mínimo: la mayoría de los usuarios cotidianos

Los chatbots de atención al cliente, los generadores de texto e imagen, los filtros de recomendación de contenido — la mayor parte de las herramientas de IA que usamos a diario caen en las categorías de riesgo limitado o mínimo. Las obligaciones aquí son principalmente de transparencia: decirle al usuario cuándo está interactuando con IA, etiquetar el contenido generado artificialmente y evitar deepfakes no consentidos.

Las fechas que tienes que tener marcadas en el calendario

El AI Act no se activó de golpe. Su implementación sigue un calendario escalonado diseñado para dar tiempo a organizaciones y desarrolladores a adaptarse. Aquí están las fechas que realmente importan:

| Fecha | Qué entra en vigor | Estado |

|---|---|---|

| 1 agosto 2024 | El AI Act entra en vigor. Comienza el período de adaptación. | ✓ Ya pasó |

| 2 febrero 2025 | Prohibición de IA de riesgo inaceptable. Obligación de alfabetización en IA para empleados que trabajen con estos sistemas. | ✓ Ya pasó |

| 2 agosto 2025 | Obligaciones de transparencia para modelos de IA de propósito general (GPAI), como los grandes modelos de lenguaje. | ✓ Ya pasó |

| 2 agosto 2026 | La fecha más importante: plena aplicación para sistemas de alto riesgo (Anexo III). Obligaciones de etiquetado de contenido generado por IA. | ⚡ En 100 días |

| 2 agosto 2027 | Extensión a sistemas de IA integrados en productos regulados (juguetes, dispositivos médicos, maquinaria). Aplicación del Artículo 6(1). | → Próximo |

⚠️ Atención – En marzo de 2026, el Parlamento Europeo votó a favor de aplazar algunas fechas de cumplimiento. Hasta que esa enmienda sea adoptada formalmente, las fechas vigentes son las del calendario original. Consulta siempre fuentes oficiales de la UE o a un asesor legal especializado antes de tomar decisiones de cumplimiento.

Qué significa agosto de 2026 en la práctica

Para la mayoría de las empresas que usan IA en sus operaciones, agosto de 2026 no implica grandes cambios inmediatos — siempre que sus herramientas caigan en las categorías de riesgo limitado o mínimo. Usar ChatGPT para redactar correos, generar imágenes para redes sociales o usar un chatbot básico de atención al cliente no activa las obligaciones más estrictas del AI Act.

Donde sí hay obligaciones concretas y urgentes es en dos ámbitos:

- Sistemas de IA de alto riesgo: cualquier empresa que use o desarrolle IA para tomar decisiones en empleo, educación, crédito o atención sanitaria debe tener documentación técnica, evaluaciones de riesgo y mecanismos de supervisión humana operativos antes del 2 de agosto de 2026. Las multas por incumplimiento pueden llegar a 30 millones de euros o el 6% de la facturación global anual.

- Transparencia sobre contenido generado por IA: desde agosto de 2026, todo contenido — texto, imagen, audio, vídeo — que haya sido generado por IA debe estar marcado de forma que sea detectable. Para los creadores de contenido y las empresas de comunicación, esto tiene implicaciones directas en sus flujos de producción.

Las restricciones más relevantes del AI Act para 2026 afectan precisamente a los sistemas más autónomos — aquellos que en nuestro artículo sobre agentes de IA y cómo funcionan describimos como la tendencia tecnológica más disruptiva del año. Entender qué son estos sistemas es el primer paso para saber si caen bajo la regulación.

¿Afecta el AI Act a empresas y creadores fuera de Europa?

Esta es la pregunta más frecuente entre el público hispanohablante de América Latina — y la respuesta es: depende de si tienes usuarios o clientes en la Unión Europea.

La lógica es la misma que hizo famoso al GDPR: si procesas datos de personas en la UE, el reglamento te aplica independientemente de dónde esté tu empresa. Con el AI Act el criterio es similar: si pones en servicio o usas un sistema de IA que afecta a personas en la UE, tienes obligaciones bajo esta regulación.

En la práctica, esto significa:

- Una empresa latinoamericana con clientes europeos que use un sistema de IA para gestionar esas relaciones — scoring de clientes, recomendaciones personalizadas, atención automatizada — puede estar en el ámbito de aplicación del AI Act.

- Un creador de contenido que distribuye vídeos o artículos a audiencias europeas y usa IA para generarlos tiene obligaciones de transparencia y etiquetado.

- Una pequeña empresa que solo opera en su mercado local sin presencia ni clientes europeos probablemente no esté directamente afectada por la regulación, aunque sí por el efecto indirecto: las herramientas de IA que usa habrán tenido que adaptar sus propias políticas para cumplir con el AI Act.

Consejo práctico – Si no tienes claro si el AI Act te aplica, el primer paso es simple: mapea qué sistemas de IA usas en tu negocio, qué decisiones toman o influyen esos sistemas, y si los usuarios afectados están en la Unión Europea. Con esas tres respuestas, cualquier asesor en cumplimiento normativo puede darte una orientación inicial en menos de una hora.

Cómo se compara Europa con el resto del mundo en regulación de IA

Europa no actúa en el vacío. Mientras el AI Act tomaba forma, el resto del mundo desarrollaba sus propias respuestas — con enfoques muy diferentes que revelan posturas filosóficas y económicas distintas sobre qué papel debe tener el Estado en la tecnología.

Estados Unidos: coordinación voluntaria y regulación sectorial

Estados Unidos ha optado hasta ahora por un enfoque descentralizado: en lugar de una ley federal integral, apuesta por la autorregulación del sector, acuerdos voluntarios con las grandes tecnológicas y regulación sectorial existente aplicada a la IA (la FTC supervisando prácticas engañosas, la FDA regulando IA médica). La orden ejecutiva de Biden de 2023 estableció principios, pero sin mecanismos de enforcement comparables a los europeos. La administración Trump, desde 2025, ha mantenido una postura explícitamente favorable a la innovación con menos restricciones regulatorias.

América Latina: regulación emergente con ritmos distintos

En la región hispanohablante, la regulación de IA está en fases muy tempranas. Brasil avanza con su propuesta de ley de IA, que sigue de cerca el modelo europeo de clasificación por riesgo. México, Colombia y Chile tienen iniciativas en proceso, pero ninguna con el nivel de desarrollo del AI Act. Por ahora, el marco regulatorio más relevante para empresas latinoamericanas que usan IA es el europeo — precisamente por su alcance extraterritorial.

China: regulación por sectores con control centralizado

China ha adoptado un enfoque diferente: regulaciones específicas para segmentos concretos — IA generativa, sistemas de recomendación de contenido, deepfakes — con supervisión estatal centralizada y sin la estructura de derechos fundamentales que enmarca la legislación europea. El objetivo declarado es diferente: asegurar la alineación ideológica y el control de la narrativa pública, además de la seguridad técnica.

Lo que nadie te cuenta sobre la regulación de la IA en Europa

Hay una narrativa limpia sobre el AI Act: Europa regula, protege a sus ciudadanos y lidera éticamente el desarrollo de la IA. Y hay otra narrativa igualmente limpia: Europa sobreregula, frena a sus empresas y pierde terreno frente a Estados Unidos y China. Ambas narrativas son convenientes. Ninguna es suficientemente honesta.

El problema del “Brussels Effect” y quién gana realmente

Cuando Europa regula a esta escala, ocurre algo que los especialistas llaman el “Brussels Effect”: las empresas globales prefieren adaptar sus productos al estándar europeo más estricto antes que mantener versiones distintas para cada mercado. Eso significa que la regulación europea termina siendo adoptada de facto en el resto del mundo — incluyendo América Latina — sin que los países de esa región hayan participado en diseñarla.

¿Quién gana con eso? Las empresas grandes, que pueden absorber los costos de cumplimiento. Las startups europeas, que compiten en un mercado con reglas claras. ¿Quién puede perder? Las empresas pequeñas que operan en múltiples mercados y no tienen equipo legal para navegar la complejidad normativa. Y los países latinoamericanos, cuyo marco regulatorio se moldea de facto por decisiones tomadas en Bruselas.

La regulación llega demasiado tarde — y demasiado pronto

Hay una paradoja inherente a regular una tecnología que evoluciona más rápido que cualquier proceso legislativo. El AI Act se concibió principalmente pensando en los modelos de IA de 2022. Los agentes de IA autónomos, la IA multimodal, los modelos de razonamiento avanzado — muchas de las capacidades más relevantes de 2026 no estaban en el horizonte cuando se redactaron los textos que hoy son ley.

Esto no invalida el esfuerzo regulatorio. Pero sí significa que la regulación más detallada y específica llega a un paisaje tecnológico diferente del que pretendía regular. Y que la siguiente actualización legislativa ya llega tarde antes de empezar.

"Regular la inteligencia artificial es como intentar escribir las reglas del tráfico mientras se inventa el automóvil. Para cuando el reglamento esté vigente, el vehículo ya es otro."

Síntesis de un debate recurrente entre reguladores, juristas y especialistas en tecnología emergente

Para entender por qué los modelos de propósito general tienen una categoría regulatoria propia en el AI Act, conviene tener claro primero cómo funcionan — algo que exploramos en detalle en nuestro artículo sobre qué son los modelos de lenguaje grande y por qué importan.

El cumplimiento como ventaja competitiva, no solo como obligación

El ángulo menos explorado del AI Act es este: para las empresas que ya operan con prácticas responsables en el uso de IA, el cumplimiento normativo no es un coste — es una diferenciación. En un mercado donde la desconfianza hacia la IA generativa es alta, poder acreditar que tus sistemas cumplen con el marco regulatorio más exigente del mundo puede convertirse en un argumento comercial real, especialmente frente a clientes corporativos y públicos europeos.

Europa ya decidió cómo quiere relacionarse con la IA — ahora te toca a ti

La regulación de inteligencia artificial en 2026 no es un tema para juristas solamente. Es una conversación sobre qué tipo de tecnología queremos en nuestras vidas, quién controla sus decisiones y qué ocurre cuando esas decisiones se equivocan.

Europa tomó una posición clara: los derechos de las personas están por encima de la velocidad de innovación. Se puede debatir si ese equilibrio está bien calibrado. Lo que no se puede es ignorar que esa posición ya tiene fuerza de ley y consecuencias prácticas para cualquiera que opere en el ecosistema digital global.

Tres ideas para llevarte de este artículo: primero, el AI Act afecta a empresas fuera de Europa si tienen usuarios europeos — no es solo un asunto interno de la UE. Segundo, la mayoría del uso cotidiano de herramientas de IA cae en las categorías de menor riesgo, con obligaciones principalmente de transparencia. Tercero, agosto de 2026 no es el final de nada — es el inicio de un ciclo regulatorio que se actualizará continuamente a medida que la tecnología evoluciona.

La pregunta que vale la pena hacerse no es “¿me afecta esta ley?” sino “¿qué me dice sobre cómo debería usar estas herramientas?”. Esa respuesta no la da ningún reglamento. La tienes que construir tú.

Preguntas frecuentes sobre La ley de IA de Europa ya está aquí

¿El AI Act europeo aplica a empresas de América Latina?

Aplica si la empresa ofrece productos o servicios a personas ubicadas en la Unión Europea o si sus sistemas de IA afectan a ciudadanos europeos, independientemente de dónde esté radicada la empresa. Es el mismo principio de alcance extraterritorial que popularizó el GDPR. Una empresa chilena, mexicana o colombiana sin ningún tipo de presencia ni clientes en Europa probablemente no está en el ámbito directo del AI Act, aunque sí verá sus efectos indirectos a través de las plataformas de IA que usa.

¿Usar ChatGPT o Claude en mi trabajo incumple el AI Act?

En la gran mayoría de los casos, no. El uso de herramientas como ChatGPT o Claude para redactar textos, analizar información o generar contenido cae en las categorías de riesgo limitado o mínimo del AI Act. Las obligaciones principales son de transparencia: identificar cuando un contenido ha sido generado por IA. Las restricciones más severas aplican a sistemas que toman decisiones automatizadas con impacto significativo sobre personas — empleo, crédito, salud — no al uso creativo o productivo cotidiano de estas herramientas.

¿Cuáles son las multas por incumplir el AI Act?

El régimen sancionador tiene tres niveles. Las infracciones por uso de IA de riesgo inaceptable (los sistemas prohibidos) pueden llegar a 35 millones de euros o el 7% de la facturación global anual, lo que sea mayor. Las infracciones por incumplimiento de obligaciones para sistemas de alto riesgo: hasta 15 millones de euros o el 3% de la facturación. Las infracciones por proporcionar información incorrecta a las autoridades: hasta 7,5 millones de euros o el 1,5% de la facturación. Para startups y pymes, estos topes se ajustan a los valores más bajos entre el porcentaje y el importe fijo.

¿Qué significa exactamente “etiquetar contenido generado por IA”?

Desde agosto de 2026, el AI Act exige que el contenido generado artificialmente — imágenes, vídeos, audio y texto en ciertos contextos — sea identificable como tal, con marcas legibles tanto para humanos como para máquinas. Esto implica watermarks digitales en imágenes y vídeos, y divulgación explícita cuando un chatbot o sistema automatizado interactúa con personas. El objetivo es que ningún ciudadano sea manipulado por contenido falso sin poder detectarlo. Los detalles técnicos específicos están siendo definidos por los organismos de normalización europeos.

¿Cómo sé si el sistema de IA que uso en mi empresa es de “alto riesgo”?

El AI Act define los sistemas de alto riesgo en su Anexo III. En términos generales, son aquellos que toman o influyen significativamente en decisiones sobre personas en ocho ámbitos: biometría, infraestructuras críticas, educación y formación, empleo y gestión de trabajadores, acceso a servicios esenciales (crédito, seguros), aplicación de la ley, gestión de migración y fronteras, y administración de justicia. Si tu herramienta de IA opera en alguno de estos ámbitos, es probable que sea de alto riesgo. La Comisión Europea publicó directrices de clasificación a principios de 2026.

¿Existe algo equivalente al AI Act en otros países hispanohablantes?

Aún no con el mismo nivel de desarrollo. España, como miembro de la UE, aplica directamente el AI Act. En América Latina, Brasil es el país con la regulación más avanzada: su proyecto de ley de IA tiene estructura similar al modelo europeo de clasificación por riesgo, aunque en 2026 aún no había sido aprobado definitivamente. México, Colombia y Chile tienen iniciativas en distintas etapas legislativas. Por ahora, el AI Act europeo es el único marco regulatorio integral en vigor con alcance global. Las empresas que quieran prepararse para la regulación futura en sus propios países tienen en el AI Act el mejor punto de referencia disponible.