IA y Fake News: Cómo Detectar la Desinformación

IA y Fake News: Cómo Detectar la Desinformación

La IA y las fake news han creado una combinación sin precedentes para la desinformación. En 2024, un video del presidente de un país latinoamericano “anunciando” medidas económicas de emergencia circuló por WhatsApp durante horas antes de ser desmentido. Era falso.

Generado con inteligencia artificial en menos de 10 minutos. Y lo habían visto casi dos millones de personas. Este tipo de incidente, antes excepcional, se ha vuelto parte del paisaje informativo cotidiano. Entender cómo la IA y las fake news interactúan —y cómo detectar la desinformación— es hoy una competencia básica de supervivencia digital.

Los datos son difíciles de ignorar. Según el Reuters Institute for the Study of Journalism, el 56% de los usuarios de redes sociales en países hispanohablantes reconoce haber compartido accidentalmente información falsa en algún momento. La velocidad de difusión de las fake news es entre 6 y 10 veces mayor que la de las noticias verificadas, según investigaciones del MIT Media Lab. Y con la IA generativa, producir un video deepfake convincente o un artículo falso con fuentes inventadas tarda menos de 30 segundos. El ecosistema de la desinformación nunca fue tan eficiente.

En nuestra experiencia monitoreando el espacio informativo digital en español, lo que más preocupa no es la sofisticación técnica de los bulos actuales —aunque es notable— sino la dificultad creciente que experimentan personas con alta alfabetización digital para distinguir lo real de lo fabricado. La desinformación ya no apunta solo a los desinformados: apunta a todos.

Pero la misma tecnología que potencia la desinformación también está siendo utilizada para combatirla. En este artículo vas a entender cómo funciona la IA para detectar fake news, qué señales delatan un contenido fabricado, qué herramientas concretas existen hoy para verificar información en español, y qué estrategias puedes aplicar para no caer en la trampa.

Qué es la Desinformación y Por Qué la IA la Ha Vuelto Más Peligrosa

La desinformación no es un fenómeno nuevo. Desde los panfletos políticos del siglo XVIII hasta los tabloides amarillistas del XX, la manipulación informativa ha existido siempre. Lo que ha cambiado radicalmente con la inteligencia artificial es la escala, la velocidad y el realismo con que puede producirse contenido falso.

Tres tipos de desinformación que la IA ha amplificado

- Desinformación generativa: textos, imágenes, audios o videos creados completamente por IA para parecer noticias reales. Los modelos de lenguaje grande pueden producir artículos con estructura periodística impecable, fuentes inventadas y datos falsos que pasan desapercibidos a primera vista.

- Deepfakes: videos o audios que muestran a personas reales —políticos, empresarios, periodistas— diciendo o haciendo cosas que nunca ocurrieron. La tecnología para crearlos es hoy accesible y gratuita en varias plataformas.

- Desinformación amplificada algorítmicamente: contenido falso que las plataformas amplifican porque genera más reacciones emocionales que el contenido verdadero. La IA de los algoritmos sociales no distingue entre verdad y mentira: distingue entre lo que engancha y lo que no.

Lo que hace especialmente peligrosa esta combinación es que opera a velocidades imposibles para la verificación humana. Cuando un equipo de fact-checkers confirma que un video es falso, ya lo han visto millones de personas. La corrección llega tarde, si es que llega.

⚠️ Atención: La desinformación por IA no solo afecta a contextos políticos. También se usa para difundir bulos de salud, fraudes financieros y manipulación de precios en mercados. El impacto no es solo informativo: puede tener consecuencias económicas y sanitarias reales.

Cómo Usa la IA para Detectar Fake News: Los Métodos que Funcionan

La paradoja del momento es que la herramienta más eficaz para detectar desinformación generada por IA es, también, la inteligencia artificial. Los sistemas de detección han avanzado significativamente en los últimos dos años, aunque ninguno es infalible.

Detección de texto generado por IA

Los modelos de detección analizan patrones estadísticos en el texto: distribución de palabras, coherencia sintáctica, uso de expresiones demasiado neutras o demasiado perfectas. Herramientas como GPTZero o el clasificador de OpenAI fueron pioneras, aunque hoy tienen tasas de error significativas. El problema es que los modelos generativos mejoran constantemente, haciendo obsoletos los detectores anteriores.

Un enfoque más robusto es la marca de agua digital (watermarking): técnicas que insertan patrones imperceptibles en el texto generado por IA para que puedan ser identificados después. Google DeepMind desarrolló SynthID con este propósito. La limitación es obvia: solo funciona si el creador de contenido coopera.

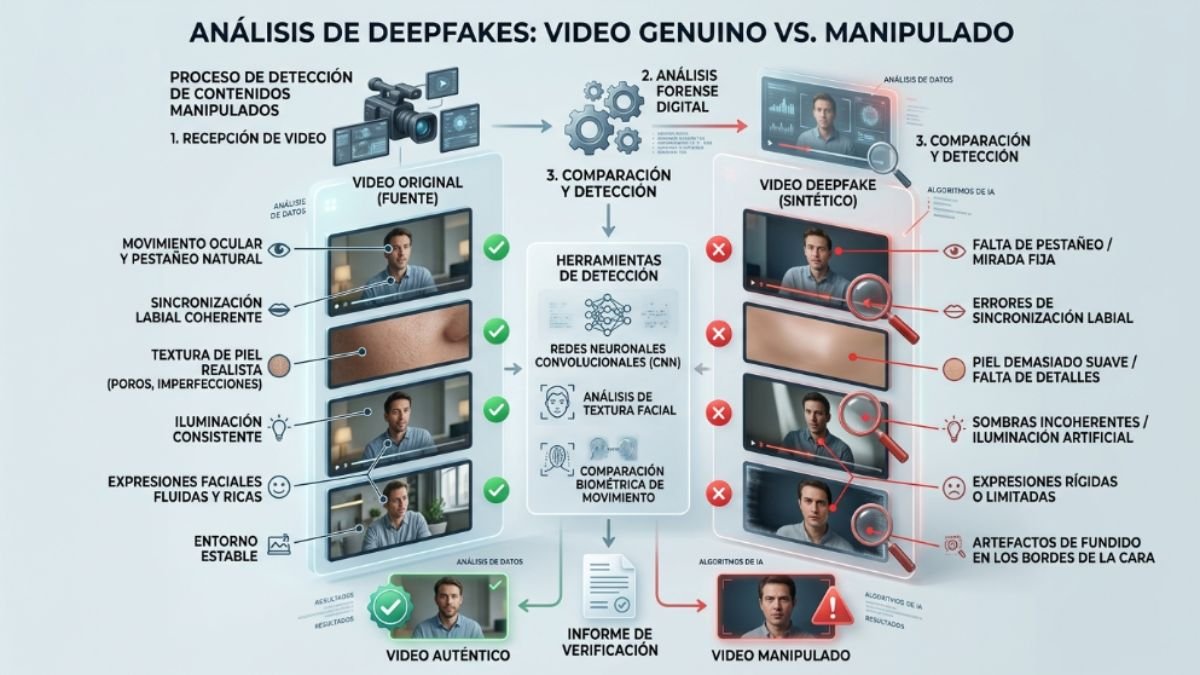

Detección de imágenes y videos deepfake

Los detectores de deepfakes analizan inconsistencias físicas imperceptibles para el ojo humano: parpadeo anormal, irregularidades en los bordes del cabello, asimetría facial, artefactos en zonas de alta frecuencia. Herramientas como Deepware Scanner, Microsoft Video Authenticator o Sensity ofrecen análisis automatizado con resultados variables según la calidad del deepfake.

Verificación de contexto y metadatos

Uno de los métodos más efectivos no analiza el contenido en sí, sino su contexto. ¿Cuándo fue tomada realmente esa foto? ¿En qué situación original aparece ese video? Herramientas de búsqueda inversa de imágenes (Google Lens, TinEye, Yandex Images) permiten rastrear el origen de una imagen en segundos. Los metadatos EXIF de las fotografías pueden revelar fecha, dispositivo y ubicación de captura, cuando no han sido eliminados.

Herramientas Concretas para Verificar Información en Español

Más allá de los detectores de IA, existe un ecosistema consolidado de plataformas de verificación con presencia activa en el mundo hispanohablante. Conocerlas es el primer paso práctico.

| Herramienta | Tipo | Cobertura | Acceso |

|---|---|---|---|

| Maldita.es | Fact-checking | España y LATAM | Gratuito |

| AFP Factual | Verificación periodística | Toda América Latina | Gratuito |

| Chequeado | Fact-checking | Argentina / región | Gratuito |

| Google Fact Check Explorer | Búsqueda de verificaciones | Global / español | Gratuito |

| Deepware Scanner | Detección deepfakes | Global | Gratuito (básico) |

| InVID / WeVerify | Verificación de video | Global | Gratuito |

🔗QUIZÁS TE INTERESE SABER: Las 7 Mejores Herramientas de IA Gratuitas para 2026: Guía Esencial

Una mención especial merece Google Fact Check Explorer: permite buscar cualquier afirmación y ver si alguna organización verificadora acreditada ya la ha analizado. Es especialmente útil para noticias que circulan por WhatsApp, donde la información llega sin fuente clara.

💡 Consejo práctico: Antes de compartir cualquier imagen impactante, haz una búsqueda inversa en Google Lens: mantén presionada la imagen en tu móvil y selecciona “Buscar imagen”. En menos de 10 segundos puedes saber si esa foto tiene años de antigüedad o fue tomada en otro contexto completamente diferente.

Señales que Delatan una Noticia Falsa: Guía Práctica

La tecnología ayuda, pero el pensamiento crítico sigue siendo la primera línea de defensa. Existen señales concretas que, con práctica, permiten identificar contenido sospechoso antes de recibir confirmación técnica.

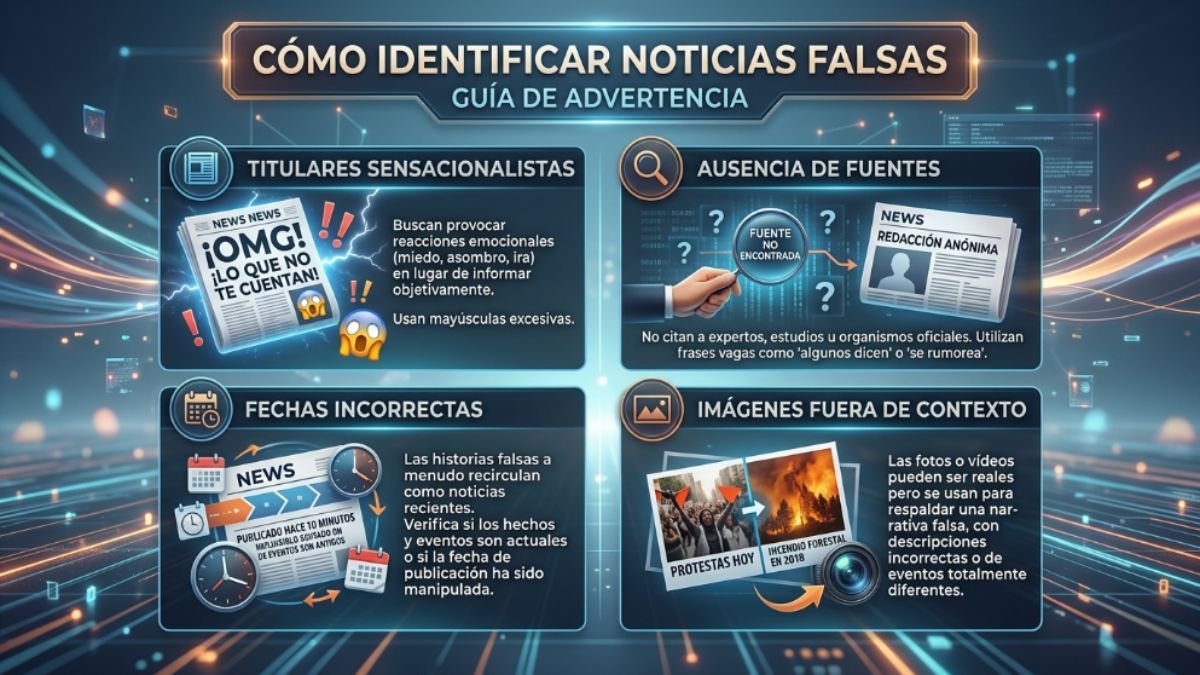

Señales en el texto

- Urgencia artificial: titulares que presionan para actuar o compartir “antes de que sea eliminado” o “mientras puedas ver esto”. La urgencia manufactured es una técnica clásica de manipulación.

- Ausencia de fuentes nombradas: afirmaciones del tipo “según expertos”, “estudios demuestran” o “fuentes cercanas aseguran” sin identificación concreta. Las noticias verificadas citan fuentes específicas.

- Carga emocional extrema: el contenido diseñado para viralizar apela a la indignación, el miedo o el orgullo. Si una noticia te produce una reacción emocional muy intensa, es señal de que debes verificarla antes de compartirla.

- Fechas y contextos desplazados: imágenes o datos reales presentados fuera de su contexto original. Una inundación de 2017 puede circular como “noticia de hoy” durante años.

Señales en imágenes y videos

- Inconsistencias en bordes y texturas: los deepfakes frecuentemente presentan irregularidades en zonas de alta complejidad visual: cabello, orejas, fondo detrás del sujeto.

- Parpadeo anormal: los primeros modelos de deepfakes casi no parpadeaban. Los actuales han mejorado, pero el parpadeo sigue siendo un punto de análisis en detección forense.

- Sincronía labial imperfecta: pequeños desajustes entre el movimiento de los labios y el audio, especialmente en sílabas oclusivas (p, b, t, d), son un indicador frecuente en videos manipulados.

El Rol de las Plataformas y los Gobiernos en la Lucha Contra la Desinformación

La responsabilidad de combatir las fake news no recae únicamente en los usuarios. Plataformas, gobiernos y organismos internacionales han comenzado a actuar, aunque los resultados son desiguales.

Qué están haciendo las plataformas

Meta, YouTube y X (antes Twitter) han implementado sistemas de etiquetado de contenido potencialmente engañoso, programas de verificación de terceros y restricciones a la amplificación de contenido marcado como falso. Sin embargo, los estudios independientes muestran que estas medidas son inconsistentes: el mismo contenido puede ser etiquetado en un país y circular libremente en otro.

Un avance concreto es la adopción de Content Credentials, un estándar técnico desarrollado por la Coalition for Content Provenance and Authenticity (C2PA) que permite adjuntar metadatos verificables a una imagen o video, indicando cómo fue creado y si fue modificado. Adobe, Microsoft, Google y Sony se han unido a esta iniciativa. Todavía es incipiente, pero representa la arquitectura técnica más prometedora para la autenticación de contenido a largo plazo.

El marco regulatorio en español

España fue uno de los primeros países hispanohablantes en impulsar legislación específica contra la desinformación, con el Plan de Acción contra la Desinformación de 2020. La Unión Europea, a través del Digital Services Act (DSA), obliga desde 2024 a las grandes plataformas a ser más transparentes sobre sus algoritmos de amplificación y a implementar mecanismos de reporte de desinformación. En América Latina, el panorama regulatorio es más fragmentado, con iniciativas en México, Argentina y Brasil que aún buscan equilibrio entre libertad de expresión y combate a los bulos.

Cómo Protegerte: Un Protocolo Personal de Verificación

Más allá de las herramientas y los marcos regulatorios, la protección más efectiva sigue siendo individual. Desarrollar un hábito de verificación antes de compartir no requiere conocimientos técnicos: requiere práctica y una pequeña inversión de tiempo.

- Pausa antes de compartir. El impulso de compartir contenido emocionalmente cargado es exactamente lo que los creadores de desinformación explotan. Esperar 30 segundos para verificar es suficiente para romper ese ciclo reflejo.

- Verifica la fuente, no solo el titular. Un titular veraz puede acompañar un artículo falso, o viceversa. Lee el contenido completo y verifica que la fuente sea identificable y tenga historial.

- Busca la noticia en medios de referencia. Si algo importante ocurrió, múltiples medios verificados lo reportarán. Si solo lo ves en un sitio desconocido o en un mensaje de WhatsApp, la probabilidad de que sea falso es alta.

- Usa una herramienta de fact-checking antes de reenviar. Google Fact Check Explorer o Maldita.es son consultas de 20 segundos que pueden evitar que propagues desinformación sin saberlo.

- Desconfía de los consensos fabricados. Frases como “todo el mundo ya sabe que…” o “nadie puede negar que…” son estructuras retóricas que intentan sustituir la evidencia por presión social.

✓ Mejor práctica: Instala la extensión de navegador de Maldita.es o NewsGuard en tu computadora. Estos plugins alertan automáticamente cuando visitas sitios con historial de desinformación, sin necesidad de verificar manualmente cada fuente que consultas.

Lo que Nadie Te Dice: La Desinformación No Busca que Creas lo Falso

Hay un malentendido fundamental en la forma en que discutimos las fake news: asumimos que su objetivo es hacer que la gente crea cosas que no son ciertas. Pero la investigación más reciente sobre desinformación sofisticada apunta a algo diferente y más perturbador.

El objetivo central de las campañas de desinformación de alta escala no es reemplazar una verdad por una mentira. Es destruir la capacidad de distinguir entre ambas. Cuando todo parece potencialmente falso, cuando cada dato puede ser cuestionado como “manipulado”, cuando la confianza en cualquier institución informativa se erosiona por completo, el resultado no es ciudadanos mejor informados sobre la falsedad. Es ciudadanos paralizados, escépticos de todo por igual, incapaces de coordinar acción colectiva sobre ningún tema.

Esta estrategia tiene un nombre en la literatura académica: firehose of falsehood (manguera de falsedades), documentada extensamente en el análisis de campañas de influencia del RAND Corporation. No se trata de convencer, sino de saturar y confundir. La IA la ha vuelto exponencialmente más barata y escalable.

“La mentira no vence a la verdad en el debate. La vence en el volumen. Satura el espacio hasta que la verdad no tiene donde aparecer.” — Hannah Arendt, Los orígenes del totalitarismo (adaptado al contexto contemporáneo)

Lo que esto significa para nosotros como usuarios es incómodo: la solución no es solo aprender a detectar noticias falsas individuales. Es comprender que vivimos en un entorno informativo que ha sido deliberadamente degradado. Eso requiere no solo habilidades técnicas de verificación, sino una postura epistémica diferente: aceptar la incertidumbre sin caer en el nihilismo informativo, seguir confiando en las instituciones de verificación independiente aunque no sean perfectas, y resistir la tentación de la certeza cómoda que a menudo ofrece la desinformación.

La IA puede detectar deepfakes con una precisión creciente. Pero la defensa más profunda contra la desinformación sigue siendo una que ningún algoritmo puede proporcionar: la disposición a vivir con preguntas abiertas en lugar de respuestas falsas que cierran el pensamiento.

Conclusión

La desinformación potenciada por IA es uno de los desafíos informativos más complejos de la era digital. No porque sea invencible, sino porque evoluciona constantemente y apela a mecanismos psicológicos que todos compartimos: la tendencia a creer lo que confirma nuestras creencias previas, la respuesta emocional antes que racional, la confianza en quien conocemos frente a instituciones abstractas.

Las herramientas de detección mejoran. Los estándares de autenticación de contenido avanzan. Las plataformas —con resistencia— implementan medidas de etiquetado. Pero el núcleo de la defensa sigue siendo el mismo: desarrollar el hábito de verificar antes de reaccionar, y entender que la desinformación más eficaz no busca que creas una mentira, sino que desconfíes de todo.

Cuatro conclusiones prácticas para llevarte: primero, usar Google Fact Check Explorer ante cualquier noticia que genere reacción fuerte. Segundo, hacer búsqueda inversa de imágenes antes de compartirlas. Tercero, instalar una extensión de verificación en el navegador. Y cuarto, recordar que el objetivo de la desinformación sofisticada no es tu opinión, es tu capacidad de confiar en algo.

¿Hay algún tipo de desinformación que te resulte especialmente difícil de detectar? Los deepfakes de audio, en particular, son todavía un territorio poco explorado en el debate público hispanohablante —y merecen una conversación aparte.

🔗 MÁS INFORMACIÓN: ¿La IA Va a Reemplazar mi Trabajo? Lo Que Dice la Ciencia

Preguntas Frecuentes sobre IA y Fake News: Cómo Detectar la Desinformación

¿Puede la IA detectar fake news con total precisión?

No existe hoy ningún sistema con precisión del 100%. Los mejores detectores de texto generado por IA tienen tasas de error del 5 al 20% según el modelo analizado. Los detectores de deepfakes funcionan bien con contenido de baja o media calidad, pero los deepfakes de alta producción siguen siendo difíciles de identificar automáticamente. La recomendación es usar los detectores como una capa adicional de análisis, no como un veredicto definitivo.

¿Cuánto tiempo lleva verificar una noticia correctamente?

Para una verificación básica —buscar en Google Fact Check Explorer y hacer búsqueda inversa de la imagen principal— bastan entre 60 y 90 segundos. Una verificación más completa, que incluye leer el artículo completo, identificar la fuente original y cruzar con al menos dos medios de referencia, toma entre 5 y 10 minutos. La mayoría de las fake news se detectan en la primera fase sin necesidad de llegar a la segunda.

¿Qué herramienta gratuita es la más útil para verificar en español?

Para noticias de texto, Maldita.es (España) y Chequeado (Argentina) son las más sólidas y tienen cobertura regional. Para imágenes, Google Lens es la opción más accesible. Para videos, la extensión InVID/WeVerify para Chrome es gratuita y analiza videos de YouTube, Twitter y Facebook con un clic. Combinar estas tres herramientas cubre la mayoría de los casos de verificación cotidiana.

¿Es ilegal crear deepfakes o noticias falsas con IA?

Depende del país y el contexto. En España, el DSA y la legislación sobre honor e imagen pueden aplicarse a deepfakes que dañen la reputación de personas reales. En la Unión Europea, crear deepfakes con fines de desinformación electoral está siendo regulado progresivamente. En América Latina, el marco legal varía significativamente por país. Lo que es uniforme es que difundir conscientemente información falsa con intención de dañar puede tener consecuencias legales en la mayoría de jurisdicciones hispanohablantes.

¿Cómo distinguir un deepfake de un video real en el móvil?

Sin herramientas técnicas, busca: parpadeo muy poco frecuente o excesivo, bordes del cabello borrosos o inconsistentes, piel demasiado “perfecta” o con textura extraña, y pequeños desajustes entre el movimiento de labios y el audio. Si tienes dudas, copia la URL del video y pégala en Deepware Scanner desde el navegador de tu móvil. El análisis tarda menos de un minuto y es gratuito para videos de hasta cierta duración.

¿Las redes sociales hacen suficiente para combatir la desinformación?

Los estudios independientes sugieren que no. Un análisis de 2024 del Oxford Internet Institute encontró que el etiquetado de contenido falso en las grandes plataformas alcanza menos del 30% de las publicaciones que merecerían una advertencia. Además, el etiquetado tiene efectos paradójicos: puede generar “efecto bumerán” en usuarios con creencias previas sólidas, reforzando en lugar de corregir sus convicciones. La regulación externa, como el DSA europeo, está intentando elevar los estándares de responsabilidad.

Héctor Nexo es especialista en inteligencia artificial aplicada a negocios digitales. Con experiencia en automatización, marketing con IA y productividad para emprendedores, fundó Portal Digital 21 para ayudar a profesionales y empresas a entender y aprovechar las herramientas de IA que están transformando el mundo digital. Su enfoque es práctico, directo y sin tecnicismos innecesarios.